La communication, c'est la clé

Non, cet article ne parle pas de conseils de couple. 😉

Mais si vous avez déjà entendu un spécialiste des relations de couple dire que la plupart des tensions viennent d’attentes non exprimées et d’hypothèses jamais vérifiées — gardez cette idée en tête. Elle va devenir étonnamment pertinente.

Cet article parle de la façon dont la plupart d’entre nous « utilisent mal l’IA ». Pas par manque de compétence, ni parce que les modèles ne sont pas assez bons, mais parce qu’on a été conditionnés à penser en termes de prompts alors qu’on devrait penser en termes de conversations.

J’ai construit un protocole de conversation qui corrige ça — un prompt réutilisable que vous collez dans n’importe quelle IA pour la faire passer du mode « exécuter immédiatement » au mode « réfléchissons ensemble d’abord ». C’est gratuit, ça fonctionne avec Claude, ChatGPT, Gemini ou tout autre modèle, et je le partage à la fin de cet article.

Si vous voulez juste l’outil, sautez directement à la section pratique. Si vous voulez comprendre pourquoi ça fonctionne et pourquoi le prompt engineering seul continue de vous décevoir — poursuivez la lecture.

Voyez par vous-même

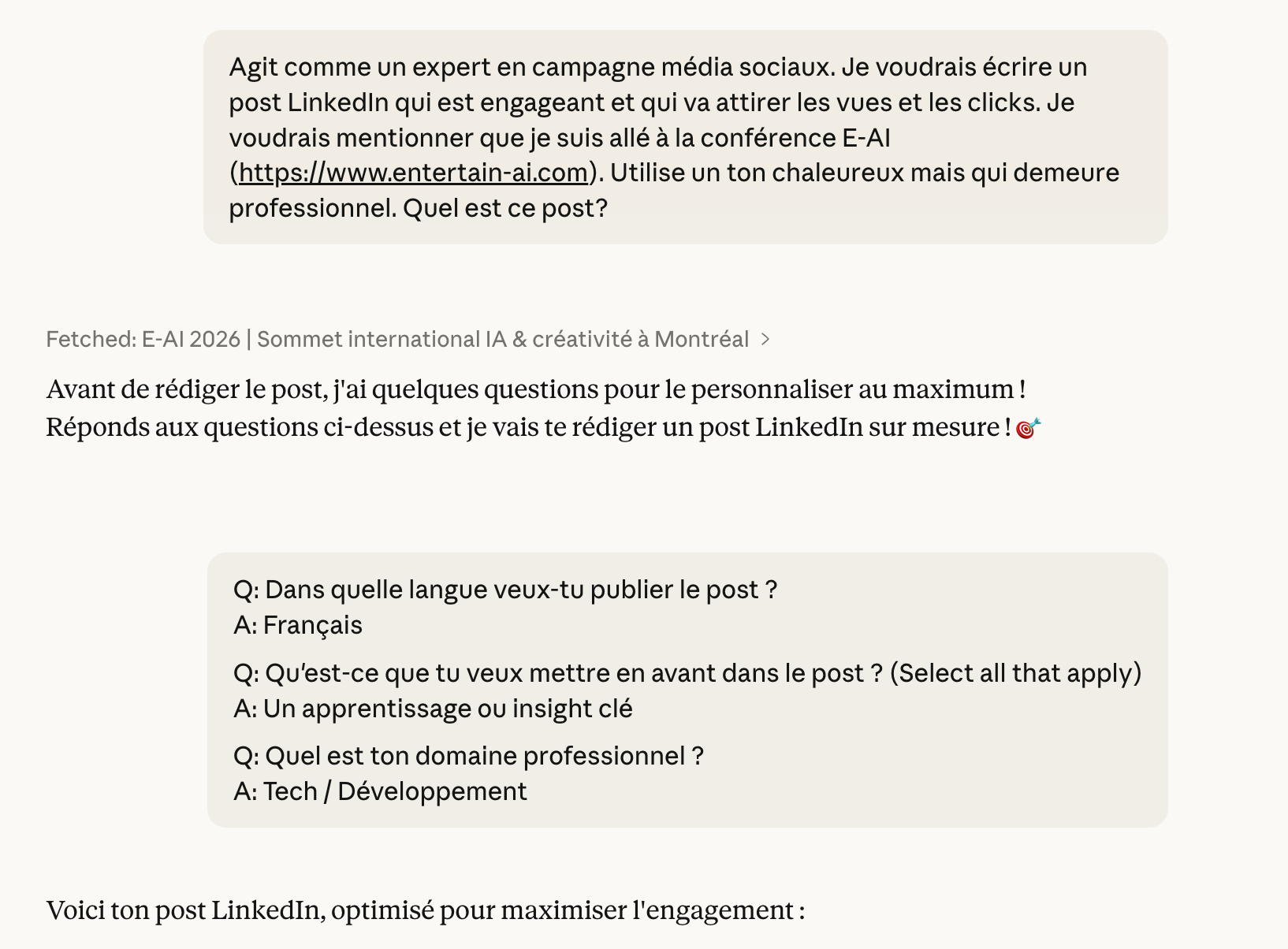

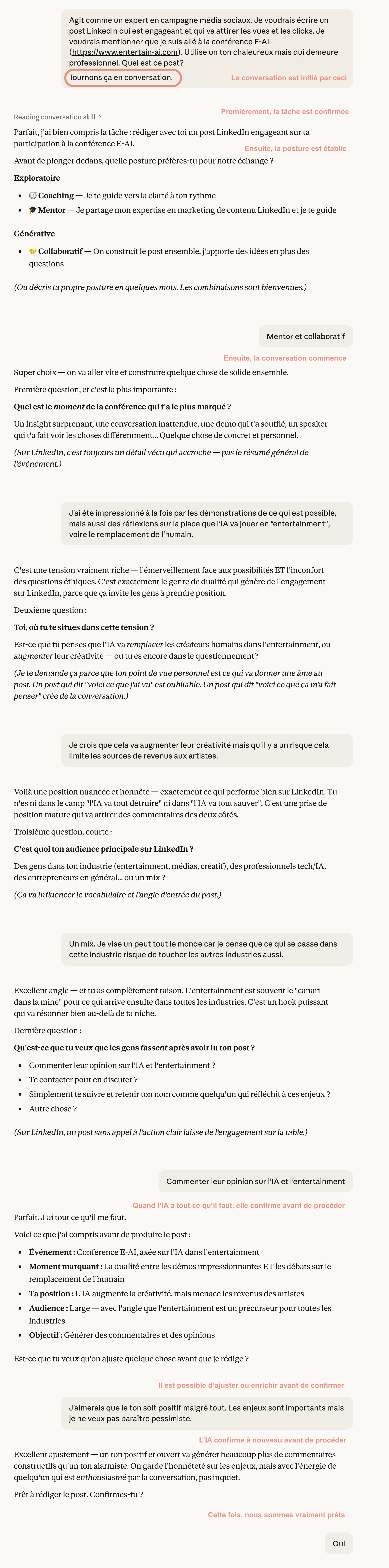

Avant de plonger dans le quoi, le pourquoi et le comment — prenez 30 secondes pour comparer ces deux exemples réels. Même tâche, même IA, même personne. Seule l’approche diffère.

Prompt seulement: j’ai demandé à une IA d’écrire un post LinkedIn sur une conférence à laquelle j’ai (fictivement) assisté. L’IA a immédiatement consulté le site de la conférence et produit un post. Fait en une passe.

Conversation d’abord: même demande, mais cette fois j’ai demandé à l’IA d’avoir une conversation avec moi avant d’écrire. Elle m’a posé des questions sur mon public, mon angle, quel moment m’avait le plus marqué, quel ton je voulais, ce que je souhaitais que les lecteurs fassent après avoir lu. Au moment d’écrire le post, elle avait un contexte que je n’aurais pas nécessairement pensé inclure dans un prompt.

Vous vous doutez sûrement de la qualité et de la pertinence des deux résponses. C’est le contexte qui détermine la qualité du résultat.

Le piège du prompt engineering

Le prompt engineering est devenu le modèle par défaut pour travailler avec l’IA. L’idée est simple: si on formule la bonne instruction — assez précise, assez structurée, avec suffisamment de contexte et de contraintes — l’IA produira ce dont on a besoin. Et ça fonctionne assez bien. Parfois remarquablement bien.

Mais il y a un défaut fondamental que la plupart d’entre nous rencontrent sans jamais le nommer: tout le fardeau de la clarté repose sur nous.

On s’attend à ce que nous anticipions ce que l’IA a besoin de savoir. On s’attend à ce que nous spécifiions le format, le ton, les contraintes, les cas limites. On s’attend à ce que nous condensions chaque détail pertinent dans une seule instruction parfaitement formulée. Et quand le résultat n’est pas tout à fait correct, le diagnostic est toujours le même: notre prompt n’était pas assez bon. “Réessayez. Soyez plus précis. Ajoutez plus de contexte. Itérez.”

Le problème, c’est qu’on ne sait pas toujours ce qu’on ne sait pas.

Une étude de Wharton publiée en 2025 a confirmé ce que beaucoup de praticiens ressentent intuitivement — le prompt engineering est « compliqué et contingent ». Des techniques qui améliorent les résultats dans un contexte peuvent nuire à la performance dans un autre. Il n’y a pas de formule universelle.

Alors peut-être que la quête du prompt parfait est une course à l’impossible.

D’où viennent vraiment les échecs

Quand l’IA produit un résultat décevant, le réflexe est de blâmer le modèle ou le prompt. Mais les données pointent ailleurs: la majorité des échecs de prompts viennent de l’ambiguïté, pas des limitations du modèle.

L’IA n’échoue pas à vous comprendre. Elle remplit les blancs que vous avez laissés — silencieusement, avec assurance, et d’une façon que vous n’aviez jamais prévue.

Quand vous écrivez un prompt en une seule passe, vous décidez quoi inclure et quoi omettre. Tout ce que vous omettez devient un vide que l’IA comble avec ses propres hypothèses. Et le vrai problème, c’est que vous ne voyez jamais ces hypothèses. Le résultat a l’air complet et soigné, alors vous l’acceptez — sans réaliser que l’IA a discrètement décidé de votre public cible, de votre ton, de votre portée ou de vos priorités à votre place.

En couple, on appellerait ça « ne pas communiquer ». Le résultat est le même: les deux parties pensent être alignées, et aucune ne réalise le contraire — jusqu’à ce que le mal soit fait.

Des prompts aux conversations

En mai 2024, les chercheurs Tea Kraljic et Shachar Lahav de Google ont publié un article dans ACM Interactions intitulé « From Prompt Engineering to Collaborating. » Leur argument: l’avenir de l’interaction humain-IA ne passe pas par de meilleures instructions. Il passe par un changement de modèle — d’un mode commande où l’humain spécifie et l’IA exécute, vers un modèle collaboratif où les deux parties partagent l’effort de façonner l’intention.

Ça correspond à quelque chose que j’ai observé moi-même. Mes meilleurs résultats avec l’IA ne venaient jamais d’un prompt unique et brillant. Ils venaient du fait d’en discuter d’abord — explorer le problème, faire surface mes propres hypothèses, laisser l’IA me poser des questions avant qu’elle se mette au travail.

Alors j’ai formalisé l’approche. J’ai construit un protocole de conversation structuré — une série d’étapes qui force l’humain et l’IA à explorer le contexte avant toute exécution.

La première fois que je l’ai utilisé sur un vrai projet, la différence était évidente. Pas une amélioration marginale — un résultat fondamentalement meilleur, parce que l’IA comprenait enfin ce dont j’avais réellement besoin plutôt que ce que j’avais réussi à taper dans une boite de texte.

L’approche: le contexte avant l’exécution

L’idée centrale est simple: séparer la réflexion de l’action.

Dans un flux de travail traditionnel par prompts, vous écrivez une instruction et l’IA agit immédiatement. Réflexion et action se confondent — et comme l’IA est empressée d’être utile, elle comble chaque vide par des hypothèses plutôt que par des questions. Sans vous le dire.

Dans une approche conversationnelle, vous créez explicitement une phase d’exploration avant l’exécution. L’IA ne produit aucun résultat. Elle pose des questions — une à la fois, en s’appuyant sur vos réponses — jusqu’à ce que vous ayez tous les deux une compréhension partagée de ce qui doit se passer. C’est seulement là que l’exécution commence. Et le résultat est ancré dans un contexte qu’aucun de vous deux n’aurait pu construire seul.

Pensez-y comme un couple qui planifie des vacances. Si vous discutez de chaque détail avant de réserver — budget, destinations, dates, quel type d’expérience vous voulez — la réservation elle-même est rapide et précise. Mais si vous commencez à réserver immédiatement et essayez de corriger le tir tour par tour (« finalement, change l’hôtel », « attends, autres dates », « est-ce qu’on peut ajouter un arrêt? »), chaque changement risque de casser quelque chose d’autre. L’approche conversationnelle met l’exploration en amont, de sorte que la première exécution est déjà nettement meilleure.

Comment ça fonctionne en pratique

J’ai construit ça comme un protocole réutilisable — un bloc de texte que vous collez avant n’importe quelle tâche, dans n’importe quelle IA. Il comporte six étapes:

1. Accuser réception et retenir. L’IA confirme qu’elle a compris la tâche et explicitement ne commence pas. C’est l’étape la plus importante. Sans elle, le réflexe par défaut de l’IA est de produire immédiatement un résultat.

2. Diagnostiquer silencieusement. Avant de poser quoi que ce soit, l’IA évalue où vous en êtes: clair et précis? Vague et exploratoire? Pas conscient de vos propres angles morts? Ça détermine la profondeur de la conversation.

3. Choisir une posture. Vous choisissez comment vous voulez que l’IA interagisse — questionnement socratique, coaching, mentorat, avocat du diable, partenaire de réflexion ou bâtisseur collaboratif. Les combinaisons fonctionnent aussi. Ça compte plus qu’on ne le pense: une conversation de “coaching” versus une avec un “avocat du diable” font émerger des choses très différentes.

4. Une question à la fois. L’IA pose une seule question, attend, et construit la suivante sur ce que vous avez révélé. Pas de paquet de trois questions dans un seul message. Si vos réponses se contredisent, l’IA le signale.

5. Point d’alignement. Quand l’IA a suffisamment de matière, elle résume sa compréhension de ce dont vous avez besoin et vous invite à la corriger. Aucun travail ne commence avant votre confirmation.

6. Exécuter — une seule fois. L’IA produit le résultat. Si votre pensée a évolué pendant la conversation — et c’est souvent le cas — le résultat reflète là où vous avez atterri, pas là où vous avez commencé.

Pourquoi ça fonctionne

Deux choses se produisent dans une conversation qui ne se produisent jamais dans un prompt en une seule passe.

Les hypothèses de l’IA deviennent visibles. Au lieu de combler silencieusement les vides, l’IA est forcée de les faire émerger sous forme de questions. Chaque question qu’elle pose est une hypothèse qu’elle n’a pas faite — et chacune vous donne l’occasion de rediriger le résultat avant qu’il soit produit.

Vos propres hypothèses deviennent visibles — pour vous-même. C’est la partie qui m’a surpris. Quand l’IA demande « qui est le public cible? » ou « qu’est-ce qui devrait primer — la rapidité ou la rigueur? », ça vous force à articuler des choses que vous aviez peut-être laissées floues, même dans votre propre tête. On découvre ce qu’on veut vraiment en étant amené à l’expliquer. La conversation est un miroir.

C’est pour ça que l’approche surpasse le prompt engineering même quand la personne qui rédige le prompt est compétente. On ne peut pas spécifier ce qu’on n’a pas encore réfléchi. Mais on peut y réfléchir en conversation.

Essayez-le vous-même

Le protocole de conversation est gratuit, et je l’offre en deux formats.

Le prompt de conversation fonctionne avec n’importe quelle IA — Claude, ChatGPT, Gemini, peu importe. Copiez-collez le texte du prompt dans votre conversation IA, puis ajoutez votre tâche là où il est indiqué « [Remplacez par votre tâche] ». L’IA va s’arrêter, accuser réception de votre tâche, et commencer à poser des questions au lieu de produire un résultat. Une fois que vous avez tous les deux exploré le contexte, elle exécute — une seule fois — avec tout ce qu’elle a appris.

Télécharger le prompt de conversationLe skill Claude est pour ceux qui utilisent Claude spécifiquement. Au lieu de copier-coller, vous l’installez une seule fois et dites simplement « tournons ça en conversation » avant n’importe quelle tâche. Pour l’installer, allez dans Customize → Skills, cliquez sur le bouton « + » et téléversez le fichier du skill. Le skill de conversation sera maintenant disponible dans tous vos chats et projets dans Claude.

Télécharger le skill ClaudeVue d’ensemble

J’ai passé la majeure partie de cet article sur la mécanique pratique, et c’était voulu. C’est une technique que vous pouvez utiliser aujourd’hui, avec n’importe quelle IA, et constater la différence dès votre prochaine tâche.

Mais il y a un schéma plus large qui mérite d’être nommé. On a tendance à traiter l’IA comme un outil qu’on opère — écrire l’instruction, obtenir le résultat, évaluer, recommencer. C’est un modèle de commande et contrôle, et il plafonne la valeur que l’IA peut livrer à ce que l’opérateur pense à demander.

Les gens qui tirent le plus de l’IA la traitent différemment. Ils la traitent comme quelque chose avec quoi on réfléchit, pas juste quelque chose à qui on délègue. Une conversation avant l’exécution, c’est l’expression la plus simple de ce changement. Pas de nouveaux outils, pas de nouvelle infrastructure. Juste la volonté de parler avant de taper.

Et si ça ressemble à un conseil de couple — je vous avais prévenu au début.

À propos de l'auteur

André Boisvert

CIO/CTO et consultant stratégique

CIO/CTO et consultant stratégique accompagnant les organisations dans l'IA, la transformation numérique et la stratégie TI. Partage de perspectives stratégiques hebdomadaires sur la technologie d'entreprise.

LinkedIn